时间: 2023-09-13 22:44:39 | 作者: 产品中心

一个由来自四大洲的5名医生和全球卫生政策专家组成的团队近日在英国医学会杂志《BMJ全球健康》发出新的呼吁,要求停止人工智能(AI)的发展,警告该技术对人类构成“生存威胁”,有三种方式能消灭人类。

据报道,新的呼吁是在1000多名科学家签署了一封呼吁停止人工智能研究的公开信后仅几周发表的。

这个由联合国大学全球健康国际研究所的一名医生领导的团队警告说,AI技术有三种方式能消灭人类。

首先,AI有帮助扩大监视和虚假信息等风险。专家们表示,人工智能有着快速清理、组织和分析由个人数据组成的大量数据集的能力,包括由日益都会存在的摄像头收集的图像,这可能使恶势力更容易上台和保持权力。

其次,该团队警告说,AI可以通过扩大使用致命性自主武器系统(LAWS)加速大规模谋杀。

最后,健康专家对潜在的严重经济破坏和人类苦难表示担忧,因为数不清的人被那些辛勤工作的机器人剥夺了生计。

不过,今天基于文本的人工智能资源,如OpenAI的ChatGPT,并不完全构成这些健康政策专业技术人员心目中的“世界末日威胁”。

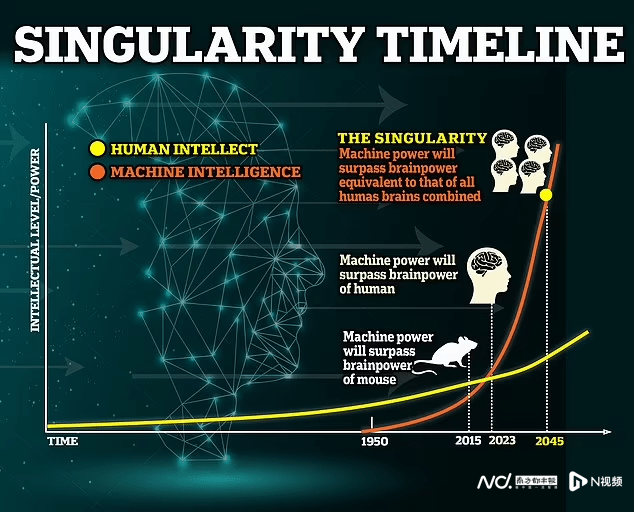

专家们表示,他们最可怕的警告适用于高度先进的、仍然是理论上的人工智能类别:自我改进的通用AI,或AGI。

AGI将更有能力真正学习和修改自己的代码,以执行今天只有人类能完成的广泛任务。

专家们认为,这样的AGI理论上能学习绕过其代码中的任何约束,并开始发展自己的目的。在某些情况下,AGI可能会对人类构成威胁,而且可能是生存威胁——如通过有意或无意地直接或间接造成了严重的伤害,攻击或征服人类,或破坏我们所依赖的系统,或耗费资源。

半数接受调查的人工智能协会成员预测,AGI可能会在2040年至2065年的某个时间开始“敲打我们的大门”。

网站备案号:沪ICP备09056488号-7